この記事は後ほど cloud.config tech blog にもマルチポストします。

この記事は後ほど cloud.config tech blog にもマルチポストします。

はじめに

この度私ことなむゆこと南條祐輝は Cloud Native Computing Foundation (CNCF) が主催する Kubernetes 関連資格を見事全て取得し、Kubestronaut の称号を授与されましたのでこちらにて自慢させていただきたく存じます。

https://www.credly.com/earner/earned/badge/d7bb7a25-8784-4be3-b43b-fd6c438bfe2c

Kubestronaut とは

Kubestronaut は、CNCF が主催している Kubernetes 関連の資格 5 つ全てを同時に有効にした人に贈られる称号です。

2024 年 3 月に行われたKubeCon Europe の 4 日目の Keynoteにて教育アンバサダープログラム関連の動きの一つとして発表されました。

同時に有効にするというのは説明が必要なのですが・・・

Kubernetes の資格には合格してから 3 年間(2024 年 4 月 1 日以降に取得したものは 2 年間になりました、残念)の有効期限があり、その期限を迎えると資格が失効します。

そのため、同時に有効にするということは 5 つ全ての資格が全てそれぞれ最後に取得してから有効期限を迎えていない状態であるということです。

Kubernetes 関連の技術は日々変化しているため、試験に合格したことがあるというだけでなく、最新の Kubernetes の知識のキャッチアップがちゃんとできているかどうかも問われるようです。

5 つ全ての資格を取得した状態にすると最後の資格を取得してから 1 か月以内に CNCF からメールが届き、上記のように Credly で Kubestronaut の称号を授与されます。

Kubernetes 資格の特徴

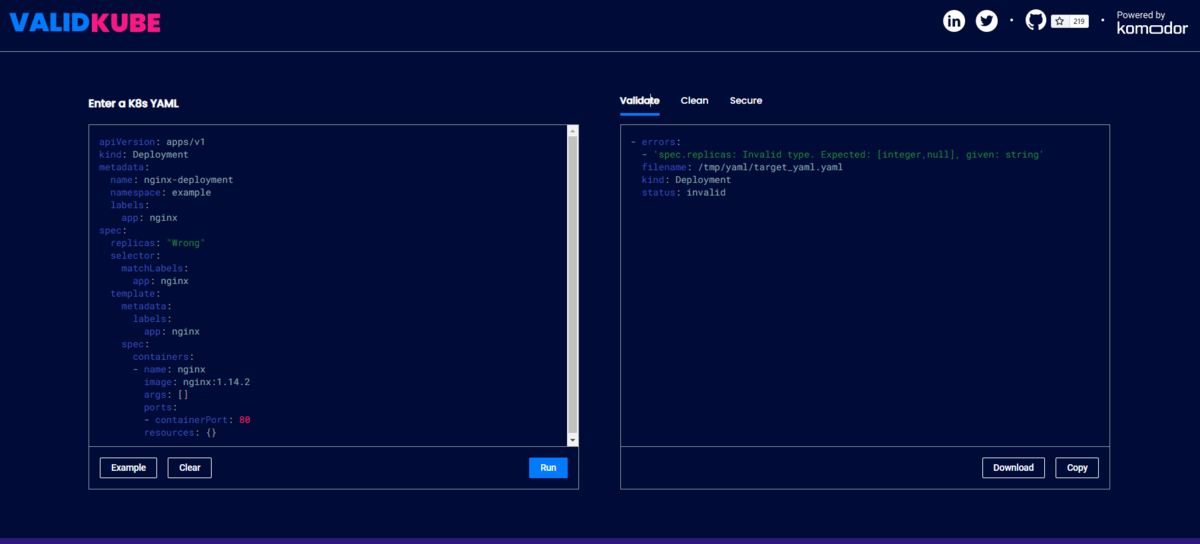

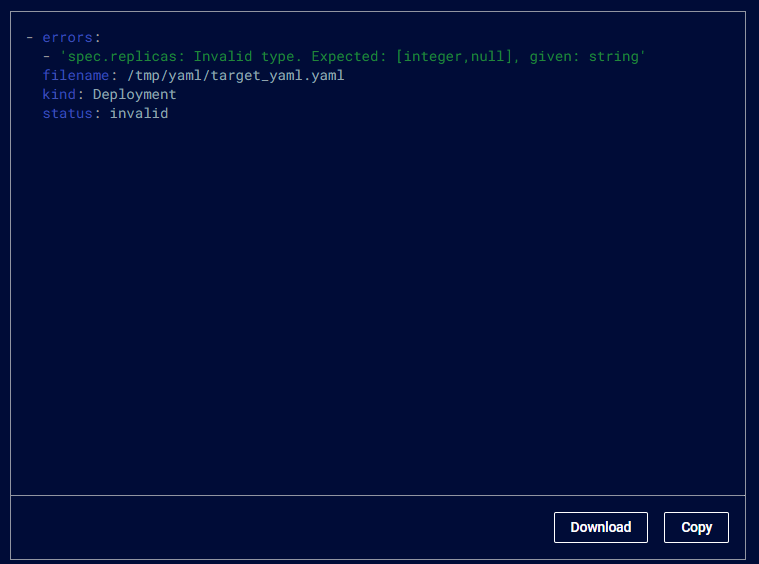

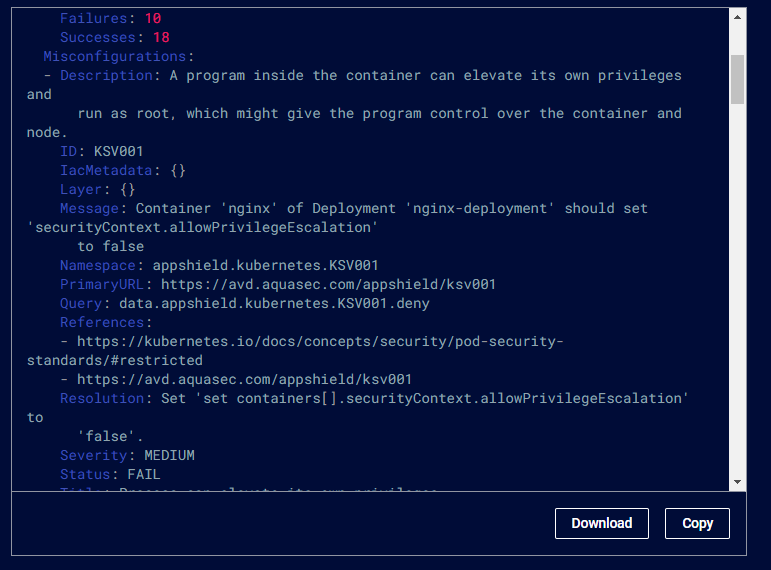

CNCF が主催している Kubernetes 資格は 5 つあり、そのうちの 3 つ(CKAD、CKA、CKS)はハンズオン形式の試験になります。

ハンズオン形式なので、試験では実際の Kubernetes 環境に接続し、コマンドラインで操作を行って問題を解きます。

問題では Kubernetes の知識を問われるだけでなく、試験時間に対して問題数が多いため個々の操作を効率的に行うテクニックも要求されます。

詳しくはKubernetes が普段使いの人のための CKAD 対策の話の記事もどうぞ。

残りの二つの試験(KCNA、KCSA)は 4 択問題を解く形式で、こちらは残りの資格の入門レベルの位置づけになります。

Kubernetes 資格の目立つ特徴としては、受験コストがそれなりに高いことが挙げられます。

CKA、CKS、CKAD の試験の価格は 2024 年 4 月現在それぞれ 395$です。

KCNA、KCSAは250$です。

もちろん日本円で支払うと為替レートの影響も受けるため、ざっくり手計算で 60000 円強、37500 円強かかることになります。

試験を管理している Linux Foundation は頻繁に試験のセールを行っているため実際にはこの価格の 7 割~半額で受験していますが、それでもこれらの資格を全て取得しようとすると受験だけでもそれなりのコストがかかります。

特典は?

Kubestronaut になると以下のような特典があるそうです。

- Kubestronaut ジャケット(こちらに写真があります)

- CNCF のイベントや資格のディスカウント(資格の維持に助かります・・・が、具体的に何割引きになるかはまだ発表されていません)

- CNCF の Ambassadorとして登録される(らしい)

なぜこの称号を狙おうと思ったのか

Kubernetes は元々業務で頻繁に使用していて自分にとって強みのある技術であると考えていたので、そのスキルが CNCF に称号として認めてもらえたら嬉しいかな、というのが一番のモチベーションでした。

副次的には具体的に有用な特典(特にディスカウントとか)もあるため、これから先 Kubernetes 資格を維持していくために有用かなと思えたのも理由の一つです。

あとは Kubestronaut Program が発表された段階で CKS、CKAD、CKA の資格を既に保持していたため、残りは入門レベルの資格である KCNA と KCSA の 2 つだけであったことも大きかったかと思います。

もし今 Kubernetes 資格を 1 つも取得していない状態で Kubestronaut Program のことを知ったとして、特典のために 1 つから資格を取得し始めていたかと思うとそうでもない気がします。

あくまでその時の状態で追加で支払うコストが比較的安くなっていたため目指しただけかもしれません。

それでもその時点で残りの 2 つの資格の取得のために 2 週間ほどの猛勉強の時間と 250$x2(セールの 3 割ほどのディスカウントはありました)のコストが必要だったのですが、その時はそれでも十分見合うだろうと考えていました。今もそう考えています。不思議です。

おわりに

今回は CNCF から発表された Kubestronaut という称号について自慢したり紹介したりしてきました。

Kubernetes の知見や取得した資格がまだない状態から狙っていくようなものではないかとは思いますが、それなりに Kubernetes について詳しかったり、すでに Kubernetes 資格を半分近く持っているという人にとってはこれまで積み上げてきたものが一つ公に認められるようなそういう称号であるように感じます。

そういった方は目指してみるべきかと思います。

参考

KubeCon + CloudNativeCon Europe 2024 Day four: Looking to the past and the future of Kubernetes (and more news

Announcing the Kubestronaut program

Kubestronaut program | CNCF

Kubestronaut Program - Linux Foundation

CNCF Ambassadors